(MAEL VALLEJO. CONTINENTE. MILENIO DIARIO)

Dos eventos recientes nos mostraron lo que –hasta hoy– sí puede y no hacer la inteligencia artificial. Y también las implicaciones que tiene para el arte, la filosofía, la literatura, la animación o cualquier industria creativa: la IA está generando y masificando copias mediocres de las creaciones humanas, muchas veces sin pagarlas, lo cual abre una discusión no solo en temas éticos sino legales y económicos.

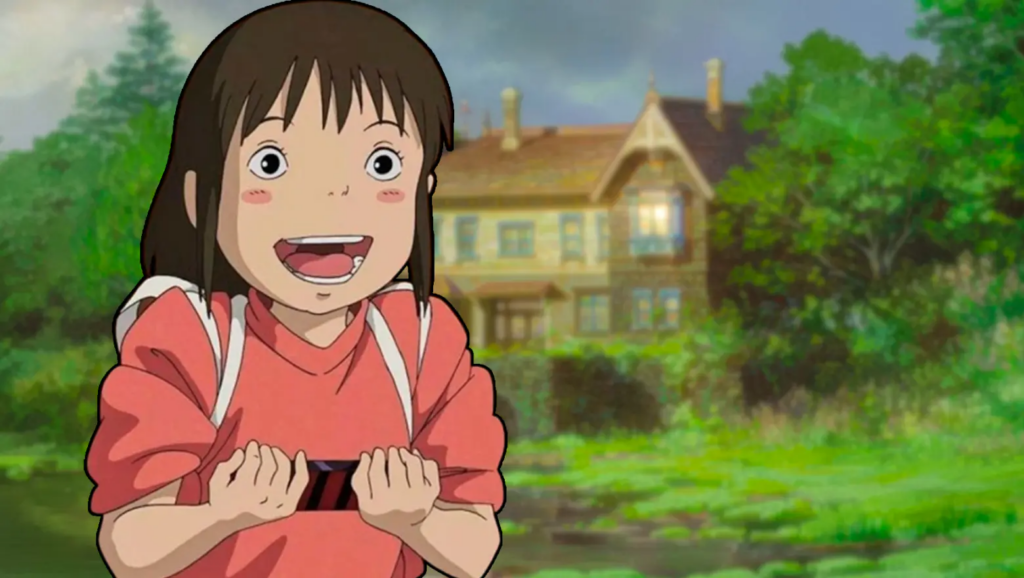

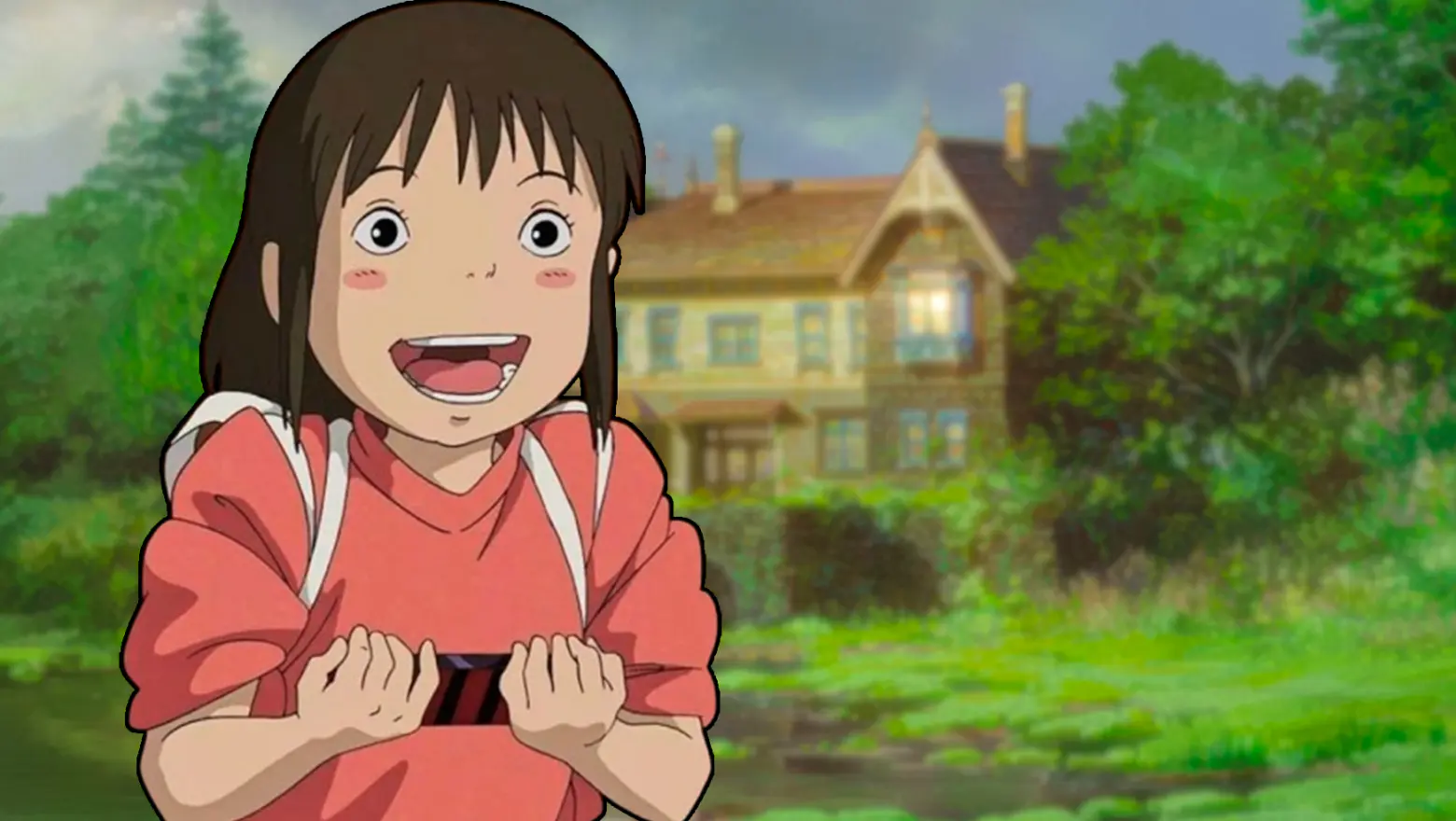

El primer evento fue el trend de Studio Ghibli: en solo unas horas millones de personas crearon con IA imágenes semejantes al estilo de ese legendario estudio japonés de animación. Las redes se inundaron de ellas y Sam Altman, cofundador de OpenAI, dijo que nunca había visto una demanda similar de los servicios de ChatGPT.

El segundo fue el descubrimiento de que Jianwei Xun, el “autor” hongkonés del libro ‘Hipnocracia’, el cual desarrolla una teoría filosófica que ya ha sido citada en diversos artículos y eventos en Europa y Latinoamérica, en realidad no existe: es el experimento de Andrea Colamedici, un ensayista italiano que usó ChatGPT y Claude para “desarrollar” la teoría, la cual presentó como obra de este filósofo ficticio. La teoría describe un tipo de régimen en el que se controla a la sociedad al manipular la percepción de la realidad.

El tema de fondo es que los large language models (LLM) o modelos extensos de lenguajes –como ChatGPT, Claude, Grok, etcétera– generan, justamente, lenguaje (texto, voz, imágenes) pero no generan conocimiento. Es decir, pueden intentar replicar el estilo de ilustración de Studio Ghibli o intentar generar una teoría filosófica, lo mismo que pueden copiar el estilo de escritura de un autor, hacer una canción similar a la de cierta banda de rock o componer parecido a un letrista. Pero, hasta ahora, no pueden generar un nuevo estilo o teoría de nada, porque no saben crear.

Estos LMM están entrenados con millones de datos, tomados de internet y otros sitios, para copiarlos y recrearlos. Muchos de ellos los han utilizado sin autorización. Por esa razón es que al menos una veintena de medios alrededor del mundo –incluidos The New York Times o Getty Images–, y escritores importantes como John Grisham, George Saunders o Jonathan Franzen, que han demandado a estas empresas por no pagarles por usar sus obras para entrenar a sus IA.

Habría que preguntarse por qué Studio Ghibli no recibe ninguna ganancia por la creación de millones de imágenes basadas en sus cuatro décadas de trabajo. O si los autores en los que se basa la supuesta teoría de “Jianwei Xun” no deberían también recibir reconocimiento y pago por el uso de sus ideas.

La IA masiva está revolucionando por completo nuestras vidas y mucho de ello se agradece. Pero el que los LLM tomen sin autorización, reconocimiento o pago el trabajo creativo, intelectual y de investigación de los humanos, no solo es una irresponsabilidad ética y legal, sino que nos va a mantener atados a la mediocridad de hacer copias baratas de trabajos monumentales.

(Los LMM tampoco deberían de usarse como buscadores. Hay demasiada gente preguntando datos a Grok en X, por ejemplo, pero la realidad es que los LLM alucinan demasiado. Es decir, producen información creíble pero falsa. No están diseñados para “saber” cosas, sino para decir cosas creíbles. Pero esa es otra discusión).

- Mael Vallejo, Periodista. VP de Contenido de Capital Digital. Coordinador del libro ‘Colapso México’. / Escribe cada 15 días (viernes) su columna Continente.